Elon Musk przewiduje, że już za 7 lat sztuczna inteligencja osiągnie poziom ludzki, czyli stanie się tak zwaną ogólną sztuczną inteligencją, AGI (Artificial General Intelligence). Musk jest znany ze swojego ogromnego optymizmu i systematycznie myli się co do terminów – ale prędzej czy później jego przewidywania się sprawdzają.

Kolejne osiągnięcia sztucznej inteligencji sugerują, że może nie omyli się tak bardzo. Google zaprezentował właśnie program generujący obrazy na podstawie opisów nazwany Imagen. Program jest znacząco lepszy od przedstawionego parę miesięcy temu przez firmę DeepMind DALL-E, który wydawał się absolutnie znakomity. Google pokazał, że może zrobić coś jeszcze lepszego.

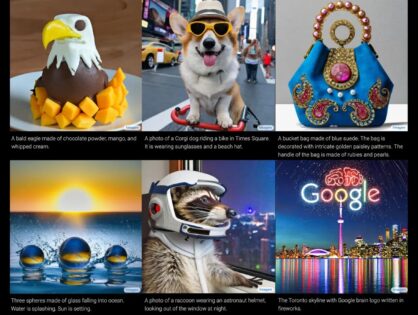

Programy „tekst na obraz” tworzą rozmaite obrazy na podstawie dowolnych krótkich poleceń, również całkowicie absurdalnych. Mogą to być obrazy impresjonistyczne i mogą być fotorealistyczne i takie Google pokazał, bo są najbardziej spektakularne. To, co widać na poniższym zdjęciu, to przykłady takich obrazów, stworzonych przez Imagen na podstawie krótkich poleceń typu „Pies rasy corgi w okularach przeciwsłonecznych i kapeluszu plażowym na rowerze na Times Square”, „Niebieska zamszowa torebka ze skomplikowanym złotym wzorem i rączką przyozdobioną perłami i rubinami”.

Google nie ujawnił, czy tak dobre obrazy powstają na podstawie każdego polecenia czy też te zaprezentowane zostały wybrane spośród mniej doskonałych. Ale nawet jeśli zostały wybrane, to przecież i u artystów-ludzi nie wszystkie dzieła są równie dobre. Te publicznie pokazane robią wrażenie nie tylko swoim realizmem ale i wiernością poleceniom – wydaje się, że nie ma rzeczy, której Imogen nie potrafiłby przedstawić.

Imogen, tak jak i inne programy tego rodzaju, uczony był na tysiącach par opis-obrazek, ale jak widać, nauczył się robić nie warianty tego, co poznał tylko dowolne obrazy na podstawie dowolnych opisów. Innymi słowy – nauczył się tworzyć. Ogranicza go tylko pomysłowość ludzi, tworzących opisy obrazów, ale i tutaj będzie ludzi mogła wyręczać sztuczna inteligencja, choćby programy typu GPT-3, które poprosimy o „tworzenie opisów absurdalnych obrazów”.

Są na pewno artyści, którzy potrafią tworzyć podobne, pewnie czasem lepsze i ciekawsze obrazy niż te, które tworzy Imogen. Ale takich ludzi jest ilu? Może 1 na milion. Czyli sztuczna inteligencja jest w tej dziedzinie lepsza niż 99,9999% ludzi. Co zresztą jest regułą: jeśli ograniczona do jakiejś dziedziny sztuczna inteligencja coś robi – gra w grę, tworzy wiersze, pisze kod komputerowy – to jest w tym lepsza niż ogromna większość ludzi. Sztuczna inteligencja, które będzie prowadziła samochód, będzie lepsza niż prawie wszyscy albo wszyscy kierowcy.

Praktyczne zastosowanie programu do tworzenie obrazów z opisów jest oczywiste: tworzenie dowolnych ilustracji do dowolnych tekstów – bez obaw o naruszenie prywatności czy praw autorskich.

Konsekwencje negatywne też są oczywiste: możliwość tworzenia całkowicie realistycznych obrazów sytuacji nieistniejących typu „Prezydent Zełenski katujący dziecko” czy „Zanieczyszczenie Wisły odpadami przemysłowymi”.

Zaledwie 10 lat temu sztuczna inteligencja nauczyła się rozpoznawać w większości przypadków zdjęcia kotów i psów. Dziś potrafi zrobić obraz psa wpatrującego się w swoje oblicze w lustrze, gdzie widzi kota.